在当今技术融合与创新的浪潮中,物联网(IoT)与人工智能(AI)已成为推动全球数字变革的核心驱动力。它们不仅深刻改变了应用场景与用户体验,更从底层对处理器架构的研发提出了前所未有的要求,并直接催生了人工智能基础软件的蓬勃发展,共同构成了一个从硬件到软件、从感知到智能的完整技术生态。

一、 物联网与人工智能:应用需求倒逼处理器架构革新

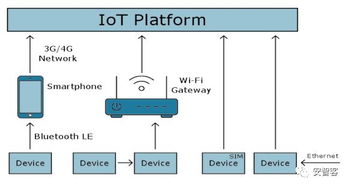

物联网的核心在于实现万物互联与数据采集,其终端设备往往具有数量庞大、分布广泛、场景多样(如智能家居、工业传感、可穿戴设备)的特点。这对处理器提出了低功耗、高集成度、低成本及特定场景下的高实时性等严苛要求。传统的通用处理器(CPU)难以在所有维度上达到最优。

与此人工智能,特别是深度学习,其模型训练与推理过程涉及海量并行计算(如矩阵乘加运算)。这对处理器的算力密度、能效比和内存带宽构成了巨大挑战。

两者的交汇,催生了处理器架构的多元化与专用化革命:

- 边缘AI芯片的崛起:为了在物联网终端设备上实现本地化、实时化的智能(如语音唤醒、图像识别),需要在资源受限的边缘侧部署AI能力。这推动了集成了AI加速模块(如NPU)的SoC(片上系统)的发展。这类芯片在架构上平衡了通用计算、连接控制与专用AI加速,实现了功耗与性能的极致优化。

- 异构计算成为主流:单一架构无法满足所有AIoT(AI+IoT)场景。因此,CPU、GPU、FPGA、ASIC以及各类专用加速器(如用于计算机视觉的VPU)的协同工作成为必然。处理器架构的设计重点转向了如何高效管理这些异构单元,实现任务的最优调度与数据的高效流通。

- 架构与算法的协同设计:为了进一步提升能效,出现了更多针对特定AI算法(如Transformer、GNN)优化的新型架构,以及采用存算一体、模拟计算等非冯·诺依曼架构的探索性芯片,旨在突破“内存墙”限制。

二、 人工智能基础软件:释放硬件潜力的关键桥梁

先进的处理器架构需要与之匹配的软件栈,才能将硬件潜力转化为实际的应用效能。人工智能基础软件正是扮演了这一关键角色,它构成了连接底层硬件与上层AI应用的中间层。其核心研发工作围绕以下几个方面展开:

- 深度学习框架的优化与演进:TensorFlow、PyTorch等主流框架正持续加强对新兴处理器架构(如各类AI加速芯片)的支持。通过开发高效的算子库、编译优化工具(如TVM、MLIR),将高层的模型描述自动编译并高效映射到底层异构硬件上,实现“一次编写,随处运行”的理想。

- 系统级软件与工具链:包括轻量化的嵌入式AI推理框架(如TensorFlow Lite、ONNX Runtime),专为边缘设备设计的操作系统(如华为OpenHarmony、谷歌Fuchsia),以及模型压缩、量化、剪枝等工具。这些软件旨在降低AI模型在资源受限的物联网设备上的部署门槛和运行开销。

- 统一编程模型与标准:为了简化异构硬件的编程复杂度,业界正致力于推动如SYCL、OpenCL等跨平台并行编程模型,以及针对AI的开放标准(如ONNX模型格式)。这有助于减少软件碎片化,提升开发效率。

- AI开发与部署平台(MLOps):涵盖从数据管理、模型训练、评估到部署、监控的全生命周期管理平台。在物联网场景下,平台需要支持从云端到边缘端的协同推理、模型OTA更新等功能,确保AI应用能够持续、稳定、安全地运行在海量终端上。

三、 协同进化:共创智能未来

物联网与人工智能的融合,并非简单的技术叠加,而是一场深刻的协同进化。物联网为人工智能提供了海量、真实、持续的数据燃料和广阔的应用试验场;人工智能则赋予物联网设备感知、分析、决策的智能,提升了数据的价值。这一循环不断向底层技术提出新需求:

- 更智能的传感器:集成初步AI预处理功能的智能传感器,可减少数据上行带宽压力。

- 更安全的架构:在硬件和基础软件层面嵌入隐私计算与安全模块,保护数据与模型安全。

- 更灵活的部署:支持动态负载分配、自适应计算的软硬件一体化方案。

结论

物联网与人工智能正如一对强大的“双引擎”,共同牵引着处理器架构向更专用、更异构、更高效的方向演进,同时也为人工智能基础软件开辟了充满挑战与机遇的研发疆域。未来的竞争,将是硬件架构创新与基础软件生态构建的综合较量。只有实现从芯片指令集到上层应用服务的全栈协同优化,才能真正释放AIoT的无限潜能,构建万物互联的智能世界。